2026年4月16日、AnthropicはClaude Opus 4.7を一般提供開始しました。難しいコーディング、より高解像度の画像理解、ファイルシステムベースのメモリ活用、Claude Codeの新しい運用機能まで含めた、かなり強い更新です。

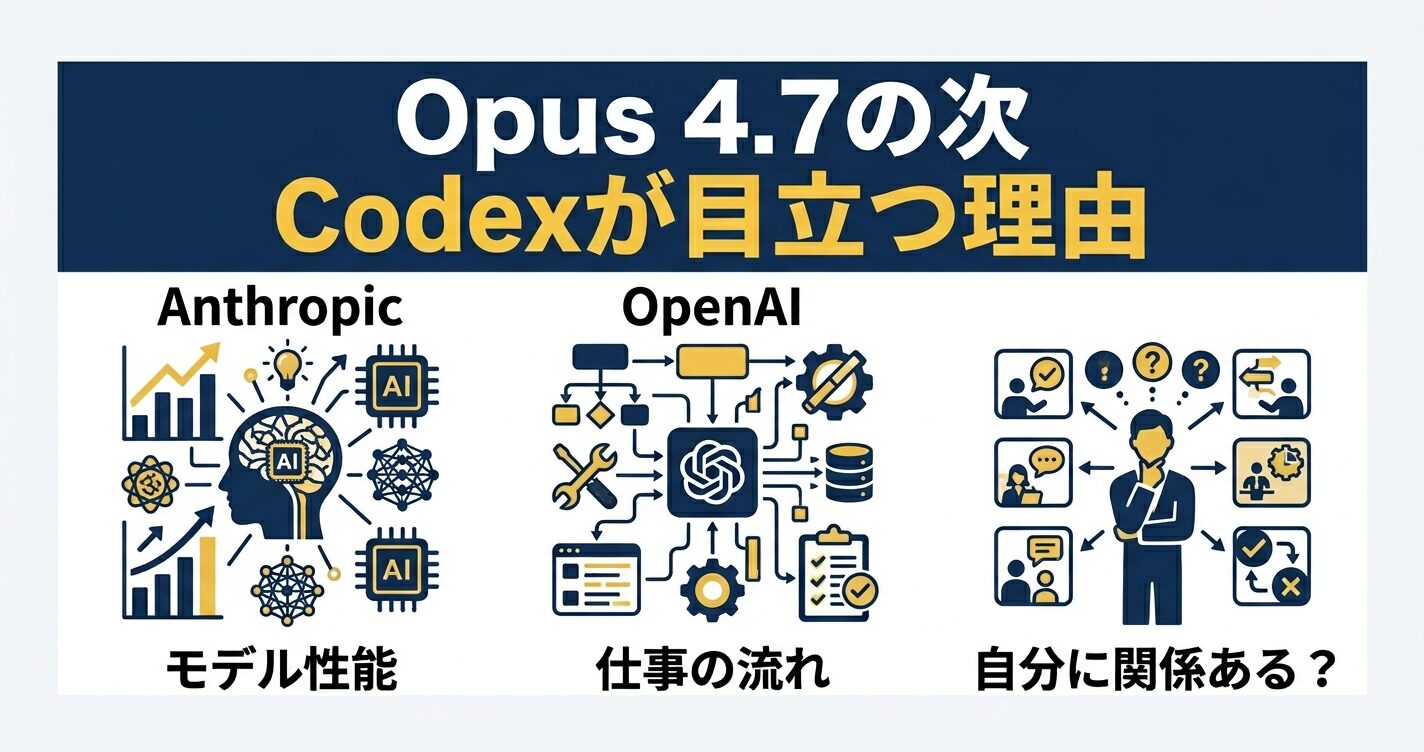

ただ、同じ時期に英語圏で目立っていたのは、「OpenAIはもう勝負の場所を少し変えてきている」という見方でした。OpenAIの最近の公式情報を並べると、Codexアプリ、Skills、Automations、Plugins in Codex、computer use、GPT Image系の活用例までつながっています。つまり、Anthropicがより強いモデルを前に出しているのに対して、OpenAIは仕事を回す場所そのものを取りにきているように見える、という話です。今回は、この見え方を一次情報ベースで整理します。

なお、「OpenAIがOpus 4.7のリリースからわずか1時間後に話題をさらった」という厳密な時刻までは、今回確認できたOpenAI公式情報だけでは断定できません。この記事では、その時系列の断定ではなく、2026年4月16日前後に見えていた競争の方向性を整理します。

先に結論だけ見たい人向けの整理

| 見どころ | Anthropic側 | OpenAI側 | どう見ると分かりやすいか |

|---|---|---|---|

| 主役 | Claude Opus 4.7 | Codexという作業環境全体 | モデル競争とワークフロー競争が分かれてきた |

| 強みの出し方 | 難しいコーディング、画像理解、メモリ、指示順守 | 並列実行、Skills、Automations、プラグイン、接続拡張 | 「賢さ」だけでなく「仕事の流れ」も争点になった |

| 読者への影響 | 難しい作業を安心して任せやすくなる可能性 | 複数の面倒な作業を同じ場所で回しやすくなる可能性 | 何が少し楽になるかで見ると違いがつかみやすい |

| いちばん大事な視点 | 最高性能のモデルを取る | 仕事の入口から出口まで握る | 今後はベンチマークだけで優劣を決めにくい |

要するに、Opus 4.7はかなり強いです。ただ、最近のCodexは「どれだけ賢いか」だけでなく、「どれだけ仕事を途中で止めずに流せるか」という別の勝負を取りにきている。そのため、同じAIの競争でも見ている場所が少し違います。

まず、Claude Opus 4.7で何が変わったのか

Anthropicの2026年4月16日の公式発表では、Claude Opus 4.7はOpus 4.6よりも、特に難しいソフトウェア工学タスクで改善したと案内されています。加えて、高解像度画像への対応強化、ファイルシステムベースのメモリ活用改善、指示順守の向上も前に出されていました。

- 高度なコーディング強化: 長く難しい作業をより安定して進めやすい

- 画像理解の強化: より高解像度の画像を扱える

- メモリ強化: ファイルに残した情報を次の作業で使いやすい

- 運用機能の追加: Claude Codeで「xhigh」努力量、「/ultrareview」、Auto mode拡張などが入った

ここで見えてくるのは、Anthropicがかなり明確にモデルの中身を強くしていることです。つまり、「前より賢い」「前より長い作業に強い」「前より画像も見える」を積み上げる方向です。

一方のCodexは、単一の新モデルより「仕事場」全体で見た方が分かりやすい

OpenAI側の面白いところは、最近のCodexが単一のモデル発表だけでは見えにくいことです。2026年2月2日の「Introducing the Codex app」では、Codexアプリを複数エージェントを並列で回す司令塔として打ち出しました。さらに、Skillsでコード以外の仕事へ広げ、Automationsで繰り返しタスクを回す方向もかなり前に出しています。

その流れに、2026年3月26日のChatGPT Release Notesで告知されたPlugins in Codexが乗りました。Codex内でプラグインディレクトリを使い、アプリ連携やSkillsをまとめたワークフローを見つけて導入できるようになっています。

さらにOpenAI全体では、computer useの公式ガイドがあり、GPT Image 1.5もすでに案内されています。Codexアプリの公式説明でも、画像生成スキルを使った事例が出ています。つまりOpenAIは、単に「コードを書くAI」を強くするだけではなく、見る、調べる、作る、繰り返す、つなぐを同じ流れに寄せようとしているように見えます。

前と何が違うのか

少し前までの比較は、「どのモデルがいちばん強いか」「どっちがコードをうまく書くか」にかなり寄っていました。もちろん今もそれは大事です。

でも今は、それだけだと足りなくなってきました。なぜなら、AIに任せる仕事はコード生成だけで終わらないからです。仕様を確認する、外部ツールにつなぐ、画像を作る、繰り返しの確認を回す、長いタスクを裏で動かす。こうした流れまで含めて考えると、「モデルの性能差」だけでは説明しきれません。

Anthropicは「最高性能モデルを前に出す」方向がかなり見えやすい。OpenAIは「最高性能モデルを使える場所を増やし、その前後の作業まで飲み込む」方向がかなり見えやすい。今回の話題化は、このズレが表に出てきたからだと思います。

誰に影響があるのか

- 開発者や小さいチーム: どのモデルが強いかだけでなく、レビュー、接続、定期タスクまで含めてどこで回すかが重要になる

- 複数の仕事を同時に抱える人: 並列実行やAutomationsがある方が、ベンチマーク差より効く場面が出てくる

- 非エンジニアでAIを仕事に混ぜたい人: コードの上手さより、「画像」「資料」「接続」「繰り返し作業」まで同じ流れで扱えるかの方が大事になりやすい

- 企業導入を考える人: 最強モデルより、運用ルール、接続、継続運用のしやすさが選定軸になりやすい

特に非エンジニア目線だと、「Opus 4.7が最強かどうか」より、「どちらが自分の面倒を少し減らしてくれるか」で見た方が実感に近いです。

逆に、気にしなくていい人

- チャット中心で使う人: 文章相談や軽い要約だけなら、ここまでの違いを急いで追わなくても大きく困らない

- 単発の1タスクしか使わない人: 並列実行やAutomations、プラグインの価値はまだ薄い

- ベンチマークを毎回追う必要がない人: まずは今の使い方でどこが詰まっているかを見る方が先です

今回の変化は大きく見えますが、全員の使い方が一気に変わるわけではありません。今の仕事で困っている場所が「考えること」なのか、「流れを回すこと」なのかで、見方はかなり変わります。

自分ならこう見る

自分なら、AnthropicのOpus 4.7は「モデルの中身をもう一段強くした更新」として見ます。難しいコーディングや長いタスクを任せる前提なら、かなり気になる更新です。

ただ、OpenAI側で本当に大きいのは、Codexを中心に仕事の入口から出口まで寄せる設計がかなり見えてきたことです。並列で回す、接続する、繰り返しを持たせる、必要なら画像まで同じ流れに乗せる。ここまで来ると、勝負は「どのモデルが上か」だけではなく、「どの会社が仕事の流れを握るか」になってきます。

だから今回の話題は、単なるOpus 4.7対Codexではありません。Anthropicはモデルで押し、OpenAIはワークフローで包みにきている。この対比として見ると、かなり整理しやすいです。

まとめ

2026年4月16日のClaude Opus 4.7は、かなり強い更新でした。難しいコーディング、画像理解、メモリ、Claude Codeの運用改善まで含めて、「モデルを強くする」方向がはっきりしています。

一方で、最近のCodex群の更新を並べると、OpenAIはもうモデル単体より、仕事を回す場所そのものを取りにきているように見えます。だから英語圏で「Opus 4.7のあとにCodexが目立った」と言われるのも、単なる話題の奪い合いではなく、競争の主語が少し変わったからだと思います。

次に読むなら、Codexそのものの入口を見たい人は ChatGPT Codexとは?、Codexの広がりを先に見たい人は Codexはもうコード専用じゃない?、作業型AIどうしを比べたい人は コードや作業で選ぶならどのAI? の方がつながりやすいです。

参考にした主な一次情報: Anthropic「Introducing Claude Opus 4.7」(2026年4月16日) / OpenAI「Introducing the Codex app」(2026年2月2日) / OpenAI Help Center「ChatGPT — Release Notes」(2026年3月26日 Plugins in Codex) / OpenAI Help Center「Using Codex with your ChatGPT plan」 / OpenAI API Docs「Computer use」 / OpenAI API Docs「GPT Image 1.5」

このブログではAIと副業の試行錯誤を書いています。X→ @yuruaibu / Threads→ @yuruaibu1 / note→ yuruaibu

コメント